025-52816006

025-52816006

邮 箱:328750080@qq.com

手 机:13917802777

电 话:025-52816006

地 址:南京市建邺区嘉陵江东街50号4幢611室

随着AI技术的普及,“克隆”特定人物声音已实现“一键式”操作,同时也带来了民事侵权甚至涉嫌犯罪的法律问题。

在互联网上,奥运冠军的“声音”突然开始推销农产品,知名演员的“声音”24小时不间断在直播间与粉丝互动……这些以假乱真的AI克隆声音正成为部分自媒体博主的“流量密码”。

据悉,依托成熟的语音大模型技术,仅需十几秒就能“克隆”任何人的声音,当声音能被轻易窃取和滥用,随之而来的侵权乱象频繁上演。

网传AI仿冒全红婵带货画面:大家好,我是你们的婵宝,今天有事请大家帮忙。婵妹就想着帮助妈妈,让家里的生活过得更好一点,同时把老家的土鸡蛋分享给粉丝们尝尝……

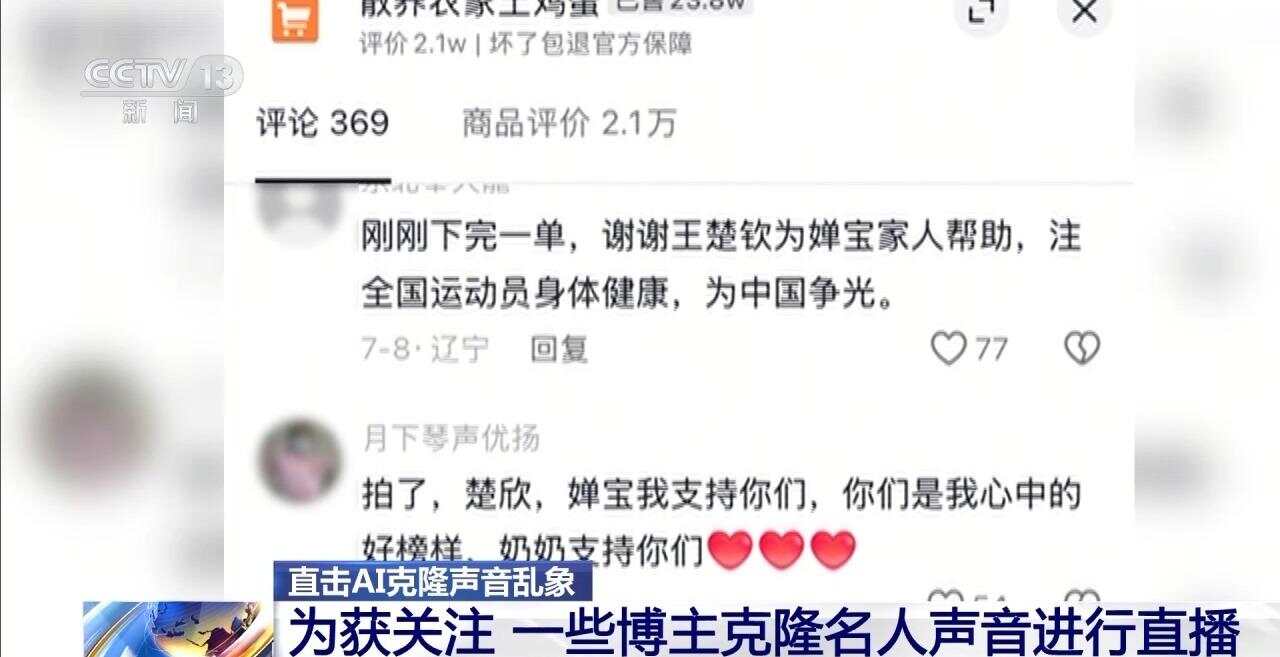

记者在抖音平台发现,在这个网名为“我是小助理吖”的博主账号中,已发布的17件作品,内容全部是利用AI仿冒奥运冠军全红婵声音带货土鸡蛋的视频,其中一个视频点赞量高达1.1万。评论区显示,大量粉丝误以为这就是全红婵本人,纷纷下单购买链接中的鸡蛋,该商品链接显示已售出4.7万件。今年4月,全红婵家人曾向媒体证实,全红婵并未给相关农产品代言或授权。

除全红婵外,奥运冠军孙颖莎和王楚钦也遭遇了同样的仿冒。在这个网名为“小兔真可爱”的账号中,两位奥运冠军的AI克隆声音同样在为土鸡蛋带货。

网传仿冒孙颖莎带货画面:大家好,我是莎莎,我为婵宝家农家土鸡蛋代言。今天我就拿到了8单做福利,它是自家散养土鸡,而且是吃粮食和草长大的,营养价值特别高。

网传仿冒王楚钦带货画面:大家好,我是王楚钦。昨天收到婵妹私信,说他们家土鸡蛋大丰收,这么好的土鸡蛋不发出去就可惜了。叫我拿给家人、粉丝们尝尝。

以假乱真的声音再加上对奥运冠军的喜爱,该网络博主也收获了大量粉丝的订单。

而记者发现,AI仿冒名人的乱象远不止带货,还有部分自媒体博主克隆名人的声音后进行24小时语音直播,演员靳东是被仿冒最多的对象,在这看似匪夷所思的操作背后,却隐藏着另一个灰色产业链。

据网络安全专家潘季明介绍,通过仿冒名人进行直播这种方式不仅可以诱骗粉丝打赏获利,还可以将一个小白账号迅速打造成上万粉丝的账号,从而再为后续牟利来铺路。

AI仿冒名人的行为,不仅欺骗了消费者,也侵犯了当事人的人格权。而AI克隆技术滥用盯上的远不止我们熟知的名人,记者调查发现,配音演员被AI克隆侵权的案例同样频繁发生。

他叫武扬,是一位从业十多年的职业配音演员,主要从事影视和广告配音。今年6月中旬,武扬突然在某餐饮企业的宣传片中听到了自己的声音,但这段配音并不是他录制的,该视频的转发量当时已达到2800多次。

面对武扬的质问,对方承认了他们利用AI克隆武扬声音的事实,但是拒绝武扬提出公开道歉的要求,声称该克隆声音是由第三方公司提供,他们没有直接责任,仅愿意支付5000元来进行赔偿,武扬拒绝了这个条件,他担心这笔钱被当成了授权费,更怕妥协后侵权会变本加厉。

与武扬的情况类似,另一位配音演员浩洋的维权也陷入了“自证循环”,侵权方不仅拒绝承认对浩洋声音克隆侵权,还试图采取拖延的方式蒙混过关。

配音演员 浩洋:他们就说要跟视频制作方沟通这个事情,过半个月后回我,怎么能证明这个声音是您呢?我就需要再去自证一下,我是我。之后他们说再跟视频制作方进行沟通,然后再回复我,现在我还在等回复。

浩洋告诉记者,从今年年初开始,他已经遭遇了多次被侵权,而他的遭遇在配音行业也并非个例。

当被滥用的AI技术成为侵权行为的掩护,合作一次就能无限克隆,遭到侵权的配音演员们决定不再隐忍,武扬目前已经收集了相关的证据,准备走法律程序起诉侵权方。

配音演员 武扬:我还是建议同行,尽量让侵权方付出更高的违法成本,这样他们就不敢轻易用AI对我们进行侵权。违法成本高了,也是对我们今后这个行业的一个保护。

有人为自己的权益被侵犯而困扰,侵权者却滥用AI技术违法牟利。那么,AI克隆声音是如何实现以假乱真的?又是谁在为“盗取声音”而推波助澜?

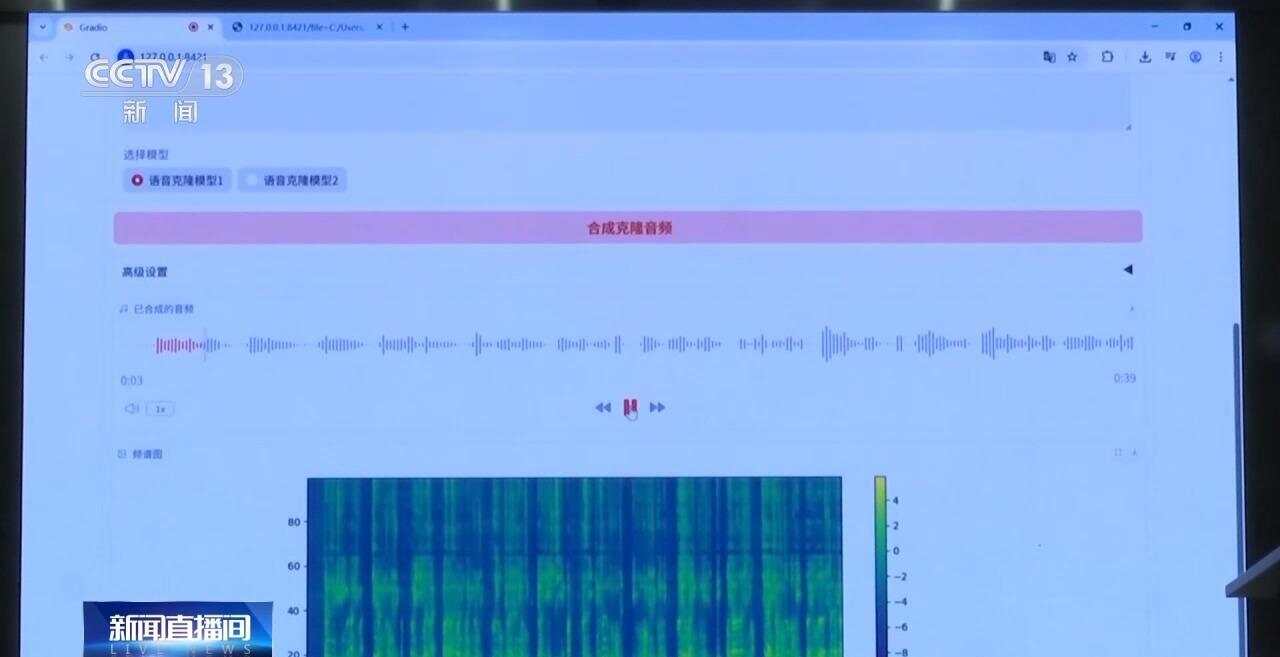

记者调查发现,在抖音、快手等网络平台上,以“声音克隆”为关键词进行搜索,能轻易找到大量相关教程视频和软件下载信息。部分博主不仅详细演示操作过程,还直接提供软件资源。

网络安全专家潘季明介绍,基于开源的语音大模型,只需一段清晰的语音样本,任何人的声音都可能在极短时间内被克隆,并能被操纵说出攻击者设定的任意内容。

据潘季明介绍,除了侵犯声音权等合法权益,AI克隆声音目前最大的隐患是被诈骗分子利用,一旦与AI换脸等技术结合,生成高度逼真的“数字人”实施诈骗,危害将非常严重。潘季明建议,目前相关的技术要从源头进行相应限制。

网络安全专家 潘季明:在开源的过程当中,我们可能需要对这些开源代码做一些使用层面上的限制,包括使用时长、应用场景上,也需要做一些具体的应用限制。

从“一听就假”到“真假难辨”,AI克隆技术的滥用不仅严重侵犯了当事者的权益,而且还涉嫌违法违规。

据法律专家介绍,我国民法典将人格权独立成编,首次以立法形式将保护“声音”写入其中,在第1023条中明确,对自然人声音的保护,参照适用肖像权保护的有关规定。

北京航空航天大学法学院副教授 赵精武:利用人工智能合成的这些声音,如果能够使得一般公众或者相关领域的公众,根据他的音色以及风格关联到特定自然人,那么就具有了法律上认定的可识别性,仍然可以构成对他人的侵权行为。我们国家的民法典1019条、1023条,都明确了相关侵权行为的认定,是没有经过肖像权人的同意作为前提的。

赵精武介绍,任何自然人的声音均应受到法律的保护,对录音制品的授权并不意味着对声音AI克隆的授权,未经权利人许可,擅自使用或许可他人使用权利人的声音构成侵权。

针对目前网络上AI克隆声音的相关内容被大量传播,相关的平台是否也应承担相应的责任呢?此类乱象该如何治理呢?

北京航空航天大学法学院副教授 赵精武:根据民法典1197条的相关规定,平台与平台用户承担连带责任有一个前提,也就是平台知道或者应当知道用户利用了它的网络信息服务,实施了侵害他人合法权益的行为,并且没有采取必要措施。这里知道或者应当知道的判断标准,主要是考虑到平台对网络信息内容的管控能力,所提供的服务性质、方式,以及引发侵权可能性的大小,平台有没有采取预防侵权措施的技术的可能,并且有没有相应的合理的措施。

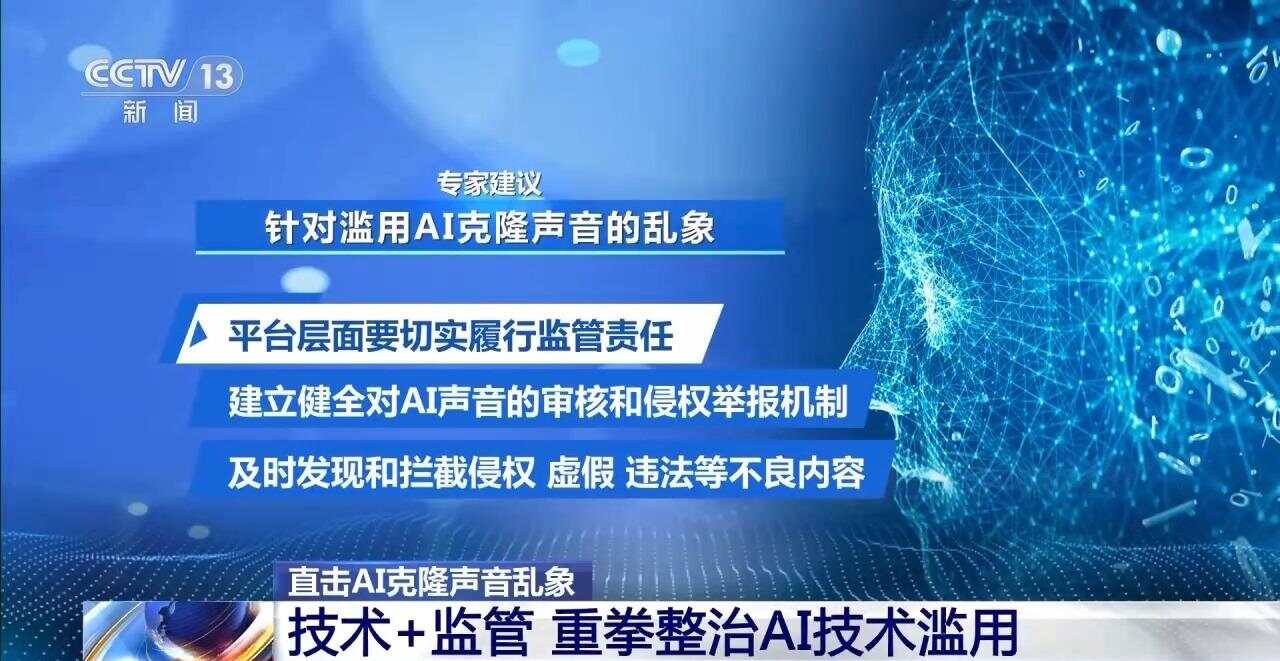

专家建议,针对滥用AI克隆声音的乱象,平台层面要切实履行监管责任,建立健全对AI声音的审核和侵权举报机制,及时发现和拦截侵权、虚假、违法等不良内容。

今年3月,国家网信办等四部门联合发布的《人工智能生成合成内容标识办法》,将于2025年9月1日起施行,其中明确了服务提供者应当对文本、音频、图片、视频、虚拟场景等生成合成内容添加显式标识等。另外,中央网信办近日在全国范围内部署开展“清朗·整治AI技术滥用”专项行动,将强化AI技术源头治理,清理整治违规AI应用程序,推动网站平台提升检测鉴伪能力等。

Copyright © 2025 九游(南京)娱乐有限公司 版权所有 备案号:苏ICP备2022015555号-1